Robert M. Ochshorn

Screen Dreams

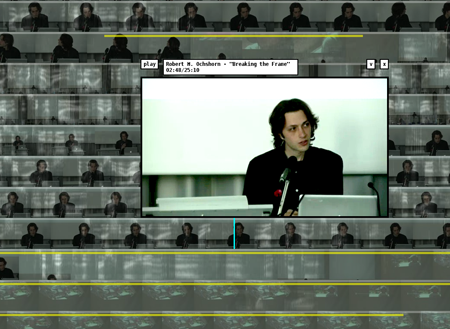

Was ist der Schlaf? Was ist Kompression von Daten? Und was sind Metadaten? Und wie hängen diese Dinge eigentlich zusammen? Screen Dreams lautet der poetische Titel der Arbeit von Robert M. Ochshorn für AOYS, der diese Zusammenhänge in einer neuen Weise erfahrbar macht. Im Zentrum steht – metaphorisch gesprochen – der Versuch, dem Computer die Fähigkeit des Menschen beizubringen, während des Träumens Gedächtnis und Erinnerungen zu bilden. Erinnern heißt, die Repräsentationen von Geschehnissen zu ordnen und einordnen. Im Unterschied zum Menschen erlaubt es der Computer große Mengen an Informationen über Daten in einer einzigen, riesigen Tabelle zu speichern. Im Fachjargon Spreadsheet genannt, dienen diese in Kalkulationsprogrammen zur Darstellung von Zahlen bzw. Textverhältnissen. Robert M. Ochshorn nutzt diese Darstellungsweise, um dem Besucher seiner Maschine das virtuelle Gedächtnis des Zentrums für Kunst und Medientechnologie in gänzlich ungewohnter Weise als ein riesiges, lebendiges Tabellenblatt zu präsentieren. Die Daten selbst sind diejenigen Dateien, die das Institut quasi als ihr öffentliches, virtuelles Gedächtnis ins Internet gestellt hat. Eine zentrale Rolle spielen dabei die so genannten Metadaten, also Informationen, die in Datenbanken mit der eigentlichen Datei als Individualisierungsmerkmale gespeichert werden. Das können beispielsweise im Fall von Videos unter anderem Aufnahmedatum, Angaben zum Dateiformat, Schlagworte zum Inhalt, Personen, die auftauchen, oder ein Filmtitel sein. Damit setzt sich Ochshorn konkret mit einer ganz besonderen Sammlung des ZKM auseinander, die eher unter technischen als unter musealen Aspekten betrachtet wird.

Der Künstler experimentiert mit dem Verhältnis von maschinellem Speichern zu menschlichem Erinnern. Hinter der Arbeit steht die Vorstellung, dass das Gehirn eine aus vielen Ebenen bestehende Hierarchie von Verarbeitungs- und Abstraktionsprozessen einsetzt, um aus Wahrnehmungen einen Sinn von der Welt in Form einer für jeden einzigartige symbolische Schicht des Bewusstseins zu konstruieren. Sie wird auf bidirektionale aufgebaut. Sie kann Stimuli aufnehmen und Wahrnehmungen reproduzieren. Ein Teil der Verarbeitung geschieht im Schlaf. Sein Versuchsaufbau geht von der Prämisse aus, dass Träume die Begleiterscheinungen im Prozess von Gedächtnisbildung und -organisation sind. Beim Menschen wirken sie aktiv auf das Gedächtnis, die Erinnerung und die “Ordnung” im “Speicher”. Der Computer stößt im Vergleich dazu schnell an seine Grenzen. Im Unterschied zu den äußerst komplizierten Prozessen, die im menschlichen Gehirn während des Schlafs ablaufen, speichert er Text, Videos, Fotos lediglich gemäß fester Regeln in Dateien auf ein Speichermedium. Diese bleiben konsistent und sind somit im Wesentlichen materieller Natur und starr. Sollte der Traum nun eine dynamische Repräsentation der Reorganisation von Gedächtnis sein, brauch der Computer Nachhilfe. Ochshorn: “Damit der Computer unseren Träumen beiwohnen kann, muss sein Codec neu geschrieben werden.” Er müsse lernen, die Mauern zwischen den Files einzureißen.

Welche Träume kann in dem Fall ein Computer träumen? Eigentlich nur unsere eigenen. Denn von wem stammen die Daten? Nachdem wir unser Gedächtnis im weitesten Sinne in Form von digitalen Dateien, Verzeichnissen und Datenbanken externalisiert haben, stellt sich die Frage, wie wir als Gesellschaft diese Daten als Erinnerungen neu erleben, wenn wir sie wieder aufrufen. Robert M. Ochshorn sucht hierfür eine spezielle Form. Er programmiert eine träumende Maschine, die unsere Träume träumt. Damit das funktioniert, müssen wir mitarbeiten. Es ist ein Träumen, verhaftet zwischen der Banalität und der Starrheit der Ansicht die Einträge, sprich von Spreadsheets, und dem Begehren und dem Potenzial, ausgedrückt im Bezugspunkt der Daten, der im Fall von Screen Dreams die Videosammlung ist, die das ZKM auf seiner Webseite veröffentlicht.

Zwei Begriffe spielen in diesem Zusammenhang eine hervorgehobene Rolle: Metadaten und Kompression. Das Bestreben des Menschen zielt in der Regel auf die Kontrolle und den Besitz von Metadaten, denn erst sie gewährleisten den Kontakt zu dem und den Zugriff auf das, was wir als bloße Daten externalisiert haben. Nackte Daten sind nach Auffassung von Ochshorn zunächst einmal ohne eigentliche Information. Erst mittels Metadaten entsteht Information, und dies seiner Meinung nach auf zweierlei Arten und Weisen: Kollektiv behandeln wir Metadaten einerseits als Autorität, wenn wir sie als unabänderliche Wahrheiten determiniert haben. Sie können jedoch andererseits als Grundlage und Ausgangspunkt für neue schöpferische Kraft dienen.

Kompression wiederum, so beschreibt es Robert M. Ochshorn, sei eine Art Urteilsvermögen, das sich auf hervorstechende Besonderheiten konzentriere. Es meine die Reduktion der Wiederholungen von Mustern und von Redundanz. Computer gebrauchen algorithmische Kompression unsichtbar. Sie sind in dazu in der Lage, geschrumpfte Dateien deterministisch zu einer Art Ähnlichem wieder auszudehnen. Das Original ist es dann nicht mehr. Etwas fällt weg. Vielleicht ein vermehrt wiederkehrendes grünes Pixel in dem Foto von einer Spielsituation eines Fußballmatches. Im Unterschied zum Menschen geht es im Kompressionsalgorithmus natürlich extrem regelhaft zu. Die Abschwächung und Verstärkung unserer menschlichen Erinnerungen hingegen, so wie sie sich im Schlaf ereignen, ist dem digitalen Speichern unbekannt.

Vordringlich brauchen wir Zugang zur digitalen Kompression sowie Schnittstellen zwischen Mensch und Maschine, Synopsen und Synekdoches, die uns helfen, nach immer größeren Katalogen mit Erinnerungen aus unserer Vergangenheit zu greifen und zu interpretieren. Screen Dreams benutzt Metadaten in einem neuen Kompressionsinterface anhand von Videos aus der Sammlung des ZKM. Während der User durch Screen Dreams navigiert, erschafft er Assoziationen und Pfade, die wiederum in und von Screen Dreams inkorporiert werden. Ochshorns Software überwacht die gesamten Interaktionen der Nutzer mit der Maschine. Sein Programm zeichnet jede Form digitaler Eingaben auf, speichert sie jedoch nicht einfach in Dateien ab, sondern übergibt sie an Prozesse quasi im Schlaf, eine vereinheitlichende Repräsentation errechnen.

Werktexte, Bio und Tech Specs: Matthias Kampmann

Robert M. Ochshorn

Screen Dreams

What is sleep? What is data compression? And what are metadata? And how are these things actually connected? Screen Dreams, Robert M. Ochshorn’s poetic title of his work produced for AOYS, makes these connections experienceable in a new way. Figuratively speaking, the work centers on the attempt to teach the computer human abilities and to form memories and recollections while dreaming. Remembering involves ordering and classifying the representation of events. Unlike human beings, this permits the computer to store enormous quantities of information on data in one huge chart. Called a spreadsheet in technical jargon, in calculation programs this facilitates the representation of numbers or relationships between texts. Robert M. Ochshorn uses this method of representation to present his machine to the visitor, the virtual memory, at the ZKM │Center of Art and Media in an entirely unique way, namely, as a huge living worksheet. The data themselves are those files that the institute presented on the Internet as its public, virtual memory. Among others, metadata, play a central role, in other words, information stored in databanks that are saved with the actual file as individualization features. In the case of videos, for example, this could be anything from the date of recording, information on file format, key words on content, persons that may appear, or a film title. In this way Ochshorn undertakes a specific analysis with a very special ZKM Collection, as considered more from the technical perspective than from museum aspects.

The artist experiments with the relationship between mechanical storage and human memory. The idea behind the work is that the human brain uses a hierarchy of processing and abstraction processes constituted of an entire range of levels, in order to construct a meaning of the world from perceptions in the form of a unique symbolic level of consciousness. They are constructed in a bidirectional manner. They can absorb stimuli and reproduce perceptions. One part of the processing occurs during sleep. His experimental setup is based on the premise that dreams are corollaries in the process of memory construction and organization. In the case of human beings, these actively impact on memory, recollection and “order” in “storage”. By contrast, the computer quickly runs up against its own limitations. In distinction to the extremely complicated processes occurring in the human brain during sleep, the computer saves texts, videos, and photographs on a storage media strictly according to fixed rules in files. These remain constant and, are thus essentially of a material nature and inflexible. However, if the dream is a dynamic representation of the reorganization of memory, then the computer requires tutoring. In Ochshorn’s own words: “For the computer to be present in our dreams, its codec must be rewritten.” It must learn to break down the walls between the files.

If this is the case, then what kinds of dreams can a computer dream? In fact, only our own, since, from whom do the data derive? Once we have externalized our memory, in the broadest sense in the form of digital files, indexes and databanks, the question then arises as to how, as a society, we can relive these data as memories when recalling them. For this purpose, Robert M. Ochshorn searches for a special form. He programs a dreaming machine, which dreams our dreams. For this to function, our collaboration is required. It is a dreaming which remains arrested between the banality and the rigidity of viewing entries, namely, the statistical spreadsheets, and the potential expressed in the data reference points, which, in the case of Screen Dreams, is the video collection which the ZKM publishes on its webpage.

In this connection, two concepts play a particularly important role: metadata and compression. As a rule, human endeavors are directed at the control and possession of metadata, since only these guarantee the contact to that which we have externalized as simple data. According to Ochshorn, naked data do not initially possess information. Only by way of metadata does information emerge, and this, says Ochsorn, occurs in two ways: collectively, we treat metadata both as authority, once we have determined them as irrevocable truths, whereas, by contrast, they can serve as the foundation and point of departure for new creative energy.

Compression, on the other hand, as Robert M. Ochshorn describes it, is a kind of faculty of judgment that focuses on salient features: the reduction of repetition and redundancy. Computers require invisible algorithmic compression. They are capable of once again deterministically expanding shrunken files into something similar. Thus, the original no longer exists. Something is dropped: perhaps, an augmented cyclic green pixel in the photograph of a situation in a game of football. In distinction to human beings, compression algorithm is extremely regular. The attenuation of our human memories, by contrast, as these occur in dream, remains unfamiliar to digital storage.

Above all else, we require access to digital compression, as well as to interfaces between man and machine, synopses and synecdoches, which help us acquire access to ever larger catalogues with memories of our pasts, and to interpret these. Screen Dreams uses metadata in a new compression interface by way of video from the ZKM Collection. While the user navigates through Screen Dreams, he creates associations and paths which are, in turn, incorporated in and by Screen Dreams. Ochshorn’s software monitors all user interaction with the machine. His program records every form of digital entry, and while not simply saving them in files, transfers them to processes in a sort of sleep, which then calculates a unifying representation.

Work description, bio and tech specs: Matthias Kampmann

Robert M. Ochshorn

Screen Dreams

Qu’est-ce que le sommeil? Qu’est-ce que c’est la compression de données? Que sont les métadonnées? Et comment sont-ils liés entre eux? Screen Dreams est le titre poétique de l’œuvre de Robert M. Ochshorn pour AOYS qui met en évidence ces relations d’une nouvelle façon. La tentative d’apprendre à l’ordinateur la capacité des être humains à constituer la mémoire pendant la durée du rêve est au cœur du projet. Se souvenir est un moyen d’organiser et de classer les représentations du passé. Contrairement aux humains, l’ordinateur permet de stocker de grandes quantités de données et d’informations dans un seul tableau géant. Appelé Spreadsheet en jargon technique, il sert à représenter les rapports entre chiffres et entre textes dans des tableurs. Robert M. Ochshorn utilise ce mode inattendu afin de présenter aux visiteurs de la machine, c’est-à-dire de son œuvre d’art, la mémoire virtuelle du ZKM comme une énorme feuille de calcul vivante. Les données elles-mêmes sont les fichiers qui ont été mise à disposition en ligne comme mémoire virtuelle de l’institution. Les métadonnées, à savoir les informations décrivant des fichiers pour alimenter des bases de données, jouent un rôle central. Dans le cas des vidéos, il s’agit notamment des informations sur la date d’enregistrement, le format de fichier, les mots clés relatifs au contenu, les personnes apparaissant dans le film ou le titre du film. Ochshorn se penche donc sur une partie de la collection du ZKM qui est souvent considérée sous un angle technique plutôt que muséale.

L’artiste joue avec le rapport entre le processus de stockage et de sauvegarde mécanographique et celui de la mémorisation humaine. Là-derrière se cache l’idée que le cerveau emploie une hierarchie multiniveau de processus de traitement et d’abstraction pour créer du sens à partir de la perception du monde – sous forme d’une couche symbolique de conscience qui serait unique pour chacun. Cette couche serait construite de manière bidirectionnelle, elle pourrait enregistrer des stimuli extérieurs et reproduire des perceptions. Une partie du traitement des informations se fait pendant le sommeil. Le dispositif expérimental de Ochshorn part du principe que les rêves sont l’épiphénomène dans le processus de formation et d’organisation de la mémoire. Chez l’homme, ils agissent activement sur la mémoire, sur le souvenir et sur l’ordre au «grenier». En revanche, l’ordinateur se heurte vite à ses limites. À la différence des procédés extrêmement complexes qui se produisent dans le cerveau humain pendant le sommeil, il sauvegarde texte, vidéo, ou photos dans des fichiers et sur un support de stockage selon des règles fixes. Celles-ci restent cohérentes et sont donc essentiellement d’ordre matériel et rigide. Si le rêve est une représentation dynamique de la réorganisation de la mémoire, l’ordinateur aura besoin de rattrapage. Ochshorn: «Pour que l’ordinateur puisse assister à nos rêves, son codec doit être réécrit». Il devra apprendre à abattre les murs entre les fichiers.

Quels rêves peut songer un ordinateur? En fait, seulement nos propres rêves. De qui les données proviennent-elles donc? Après avoir externalisé notre mémoire sous forme de fichiers numériques, de registres et de bases de données, se pose alors la question de savoir comment on éprouverait, en tant que société, ces données comme souvenir une fois récupérées. Pour cela, Robert M. Ochshorn est à la recherche d’une forme spécifique. Il a programmé une machine à rêver pour songer nos rêves. Pour que cela fonctionne, nous devons collaborer. C’est une rêverie basculant entre la banalité et rigidité des entrées de la feuille de calcul, et le potentiel intrinsèque de la collection vidéo du ZKM publiée sur son site internet.

Deux notions jouent un rôle important dans ce contexte: les métadonnées et la compression. Nos efforts sont généralement guidés par la volonté de posséder et de contrôler des métadonnées, car ils fournissent le contact et l’accès à ce que nous avons externalisé comme de simples données. Selon Ochshorn, les données en soi ne portent aucune information. C’est que par les métadonnées qu’apparaît l’information, et ceci en trois manières: collectivement, nous traitons les métadonnées comme une autorité, une fois établies comme immuable. Cela étant, ils peuvent aussi servir de point de départ pour une nouvelle force créatrice.

En revanche, la compression serait selon Robert M. Ochshorn une capacité de jugement qui met l’accent sur certaines particularités distinctives. Elle vise à réduire la répétition de motifs et la redondance. Les ordinateurs utilisent la compression algorithmique de façon invisible. Ils sont capables d’étendre à nouveau des fichiers préalablement rétrécis à une forme semblable à l’original. Pourtant, l’original n’existe plus. Quelque chose disparaît, s’évanouit. Peut-être un pixel vert récurrent dans la photo d’un match de football? Contrairement aux humains, l’algorithme de compression fonctionne cependant de manière très régulière. L’affaiblissement et l’amplification de nos souvenirs humains comme ils se produisent pendant le sommeil sont toutefois inconnus du stockage numérique.

Tout d’abord, il nous faut l’accès à la compression numérique, des interfaces entre homme et machine, ainsi que des synopses et des synecdoques qui nous aident à recourir aux catalogues toujours plus importants de nos souvenirs et de les interpréter. Screen Dreams utilise des métadonnées dans une nouvelle interface de compression à l’aide des vidéos de la collection du ZKM. Pendant que l’utilisateur navigue dans Screen Dreams, il crée des associations et des chemins qui seront à leur tour intégrés dans et par Screen Dreams. Le logiciel de Ochshorn surveille toute interaction des utilisateurs avec la machine. Il enregistre toutes les entrées numériques, mais au lieu de les sauvegarder simplement dans des fichiers, il utilise les scénarios pour calculer une représentation plus uniforme – tout comme pendant le sommeil.

Texte, biographie et spécifications : Matthias Kampmann

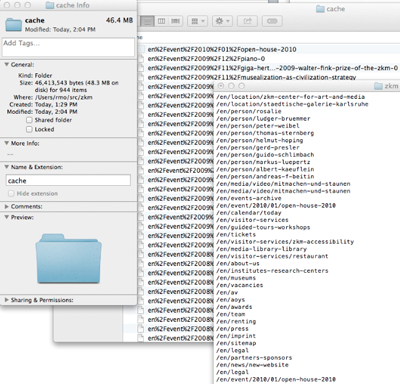

Die Software von Screen Dreams

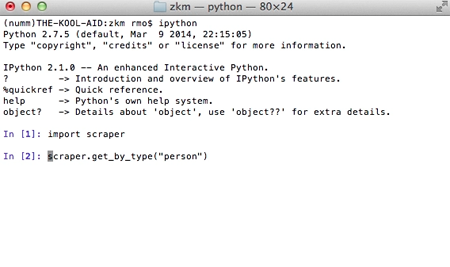

Screen Dreams ist ein Bundle aus Open Source-Software, die zum überwiegenden Teil von Robert M. Ochshorn selbst geschrieben wurde. Grob lässt sich das Werk als Software zur automatischen Bearbeitung von Video-Dateien, geschrieben in der Skriptsprache Python, definieren.1 Benutzt wird dabei auch andere Software, etwa das Multimediaframework ffmpeg2 und die Programmbibliothek NumPy3 (siehe Codebeispiel) für wissenschaftliche Berechnungen.

Die Daten liefert ein von Robert M. Ochshorn geschriebener Server aus. Dieser basiert auf Python und der ereignisgesteuerten Netzwerk-Engine Twisted (ebenfalls in Python geschrieben).4 Ochshorn hat sich dabei vom CouchDB-Projekt5 inspirieren lassen.

Das Frontend ist in JavaScript, HTML5 und unter Verwendung von WebGL programmiert.

videorow.py ist ein Beispiel, das aus vorhandenen Filmen Timelines generiert.

Das #-Zeichen im Code dient dazu, Kommentare zu verfassen, die nicht ausgeführt werden.

1 # Generieren von 960 x 96 Pixel grossen, automatisch zusammengesetzten

2 # Timelines (Zeitachsen) eines Videos.

3 # NumPy ist eine Library fuer Python, die wissenschaftliche Berechnungen ermoeglicht.

4 # Sie bringt ein maechtiges multidimensionales Array-Objekt mit, das fuer

5 # anspruchsvolle Bildmanipulationen genutzt werden kann.

6 import numpy as np

7

8 # Robert M. Ochshorn programmiert und betreut eine Library namens “numm”,

9 # die Medienformate in NumpyArrays auf einfache Weise modifiziert.

10 import numm3

11

12 # Ausgabeparameter definieren. Diese sind kongruent mit dem

13 # JavaScript-Frontend.

14 WIDTH = 960

15 HEIGHT= 96

16

17 def row(vpath):

18 “return a NumPy array timestrip corresponding to a video”

19

20 # Metadata aus dem Video beziehen

21 meta = numm3.video_info(vpath)

22

23 # Ermitteln der Anzahl der Bilder pro Sekunde (fps), um einen Frame per Pixel zu bekommen.

24 fps = (WIDTH-1) / meta[“duration”]

25

26 # Register fuer Bildausgabe. Genutzt wird dtype=int (anstelle von uint8)

27 # um Overflows zu vermeiden.

28 acc = np.zeros((HEIGHT, WIDTH, 3), dtype=int)

29 # Wie oft empfaengt jede Spalte im Spreadsheet einen Video-Frame?

30 hits= np.zeros(WIDTH)

31

32 # Da wir eine fps-Dekodierung entsprechend zur Ausgabebreite berechnet haben,

33 # sind Zeit und Raum äquivalent und unser Frame-Index bildet zugleich unsere

34 # X-Koordinate.

35 for x,fr in enumerate(numm3.video_frames(vpath, height=HEIGHT, fps=fps)):

36 # Sobald wir das Ende des Streifens erreicht haben, beschneiden wir den Frame

37 w = min(fr.shape1, WIDTH-x)

38

39 # Manchmal ist die “Dauer”, die video_info ausgibt, ein wenig

40 # ungenau. Ein Overflow waere die Folge, also ignorieren wir diese Information.

41 if w > 0:

42 # Wir nutzen die Array-Indexierung von NumPy, um diesen Frame in

43 # einen gleitenden Unterabschnitt der Ausgabe-Timeline zu speichern.

44 acc[:,x:x+w] += fr[:,:w]

45 # …und um festzuschreiben, welche Spalten wir gespeichert haben

46 hits[x:x+w] += 1

47

48 # Zu guter Letzt koennen wir das Register durch den Hits-Array teilen und

49 # konvertieren unser Ergebnisregister zurueck in ein achtbittiges Array aus Ganzzahlen:

50 # Dies ist die native Datenbreite der meisten digitalen Bilddateiformate.

51 out = (acc / hits.reshape((1, -1, 1))).astype(np.uint8)

52 return out

53

54 if name__==’__main’:

55 # Kommandozeilenprogramme, um Video-Reihen zu erstellen.

56

57 import glob, os, sys

58

59 # Verzeichnis, in dem die Videos gesucht werden

60 vdir = sys.argv1

61 # Ausgabeverzeichnis

62 odir = sys.argv2

63 # Wenn es nicht existiert, Ausgabeverzeichnis anlegen

64 if not os.path.exists(odir):

65 os.makedirs(odir)

66

67 # Alle mp4- und m4v-Dateien im Eingabeverzeichnis finden

68 for vpath in glob.glob(os.path.join(vdir, “.m*4”)):

69 # Den Dateinamen des Videos fuer eine PNG-Bilddatei verwenden

70 opath = os.path.join(odir, “%s.png” % (os.path.basename(vpath).split(“.”)0))

71 # Falls das Skript wieder laeuft (wenn also der Downloader

72 # arbeitet), quaelen wir uns nicht mit dem erneuten Berechnen existenter Timelines.

73 if not os.path.exists(opath):

74 # Sichern der Ausgabe unserer “row”-Funktion in einer Bilddatei.

75 numm3.np2image(row(vpath), opath)

1 S. https://www.python.org (Stand 30.09.2014).

2 S. https://www.ffmpeg.org/about.html (Stand 30.09.2014).

3 S. http://www.numpy.org (Stand 30.09.2014).

4 S. https://twistedmatrix.com/trac/ (Stand 30.09.2014).

5 S. http://couchdb.apache.org (Stand 30.09.2014).

The Screen Dreams Software

Screen Dreams is a bundle consisting of Open Source software written, for the most part, by Robert M. Ochshorn himself. Roughly speaking, the work may be defined as software for the automatic processing of video files written in the script language Python.1 Here, other software is also used, such as the multimedia framework ffmpeg2, and the program library NumPy3 (see code example) for scientific calculations.

The data are supplied by a server written by Robert M. Ochshorn. This is based on Python and the events-regulated network engine Twisted (likewise written in Python).4 For this Ochshorn drew inspiration from the CouchDB project5.

The front end is in JavaScript, HTML5 and programmed with the use of WebGL.

videorow.py is one example which generates timelines from existing films.

The #-sign in the code serves for writing non-executed commentaries.

1 # Generation of 960 x 96 pixel size, automatically compiled

2 # Timelines (time axis of a video.

3 # NumPy is a library for Python, which facilitates scientific calculations.

4 # It brings with it a powerful multi-dimensional array object: fire

5 # Sophisticated image manipulations can be used.

6 import numpy as np

7

8 # Robert M. Ochshorn programs and monitors a library called “numm”,

9 # which modifies the media formats in NumpyArrays in an easy way.

10 import numm3

11

12 # Define output parameters. These are congruent with

13 # JavaScript Frontend.

14 WIDTH = 960

15 HEIGHT= 96

16

17 def row(vpath):

18 “return a NumPy array time strip corresponding to a video”

19

20 # Obtain metadata from the video

21 meta = numm3.video_info(vpath)

22

23 # Investigate the number of images per second (fps) to obtain a frame of the pixels.

24 fps = (WIDTH-1) / meta[“duration”]

25

26 # Register for image edition. dtype=int is used (instead of uint8)

27 # to avoid overflows.

28 acc = np.zeros((HEIGHT, WIDTH, 3), dtype=int)

29 # How often does each column in the spreadsheet receive a video frame?

30 hits= np.zeros(WIDTH)

31

32 # Because we calculated an fps decoding corresponding to the edition width,

33 # time and space are equivalent and our frame-index simultaneously forms our

34 # X-coordinates.

35 for x,fr in enumerate(numm3.video_frames(vpath, height=HEIGHT, fps=fps)):

36 # As soon as we have reaced the end of the strip, we cut the frame

37 w = min.(fr.shape1, WIDTH-x)

38

39 # Sometimes the “duration” issued by the video_info is a

40 # little imprecise. An overflow would be the consequence, so we ignore this information.

41 if w > 0:

42 # We use the NumPy Array Indexing to save this frame in

43 # a sliding subsection of the edition-timeline.

44 acc[:,x:x+w] += fr[:,:w]

45 # …and in order to determine which columns we have saved

46 hits[x:x+w] += 1

47

48 # Last but not least, we can divide the register by the Hits-Array and

49 # convert our results register back into an eight-bit Array from integers:

50 # This is the native data width of most of the digital image file formats.

51 out = (acc / hits.reshape((1, -1, 1))).astype(np.uint8)

52 return out

53

54 if name__==’__main’:

55 # Commando line programs, to create video series.

56

57 import glob, os, sys

58

59 # Index, in which the videos are sought for

60 vdir = sys.argv1

61 # Edition index

62 odir = sys.argv2

63 # If it doesn’t exist, create an edition index

64 if not os.path.exists(odir):

65 os.makedirs(odir)

66

67 # Find all mp4- and m4v-files in entry index

68 for vpath in glob.glob(os.path.join(vdir, “.m*4”)):

69 # Use file name of video for a PNG-image file

70 opath = os.path.join(odir, “%s.png” % (os.path.basename(vpath).split(“.”)0))

71 # In case script runs again (in other words, if the downloader

72 # works), then we don’t have to torture herself with the newly calculated existent timelines.

73 if not os.path.exists(opath):

74 # Secure the edition of our “row” function in an image file.

75 numm3.np2image(row(vpath), opath)

1 https://www.python.org (visited 30.09.2014).

2 https://www.ffmpeg.org/about.html (visited 30.09.2014).

3 http://www.numpy.org (visited 30.09.2014).

4 https://twistedmatrix.com/trac/ (visited 30.09.2014).

5 http://couchdb.apache.org (visited 30.09.2014).

Le Logiciel derrière Screen Dreams

Screen Dreams est un libellé de logiciels open-source qui a été écrit en grande partie par Robert M. Ochshorn lui-même. Défini au sense large, l’oeuvre est un outil de gestion automatique de fichiers vidéo, rédigés en langage Python. D’autres logiciels sont utilisé aussi, tels que le framework multimédia ffmpeg et la bibliothèque logicielle NumPy (voir exemple de code) pour les calculs scientifiques.

Les données sont fournies depuis un serveur programmé par Robert M. Ochshorn. Ceci est basé sur Python et le framework d’application réseau Twisted (également écrit en Python). Ochshorn s’est inspiré du projet CouchDB .

Le frontal est programmé en JavaScript et HTML5 en utilisant WebGL.

videorow.py est un exemple qui génère des frises chronologiques à partir de films disponibles.

Le caractère # dans le code sert à écrire des commentaires qui ne seront pas exécuter.

1 # Generation of 960 × 96 pixel size, automatically compiled

2 # Timelines (time axis of a video.

3 # NumPy is a library for Python, which facilitates scientific calculations.

4 # It brings with it a powerful multi-dimensional array object: fire

5 # Sophisticated image manipulations can be used.

6 import numpy as np

7

8 # Robert M. Ochshorn programs and monitors a library called “numm”,

9 # which modifies the media formats in NumpyArrays in an easy way.

10 import numm3

11

12 # Define output parameters. These are congruent with

13 # JavaScript Frontend.

14 WIDTH = 960

15 HEIGHT= 96

16

17 def row(vpath):

18 “return a NumPy array time strip corresponding to a video”

19

20 # Obtain metadata from the video

21 meta = numm3.video_info(vpath)

22

23 # Investigate the number of images per second (fps) to obtain a frame of the pixels.

24 fps = (WIDTH-1) / meta[“duration”]

25

26 # Register for image edition. dtype=int is used (instead of uint8)

27 # to avoid overflows.

28 acc = np.zeros((HEIGHT, WIDTH, 3), dtype=int)

29 # How often does each column in the spreadsheet receive a video frame?

30 hits= np.zeros(WIDTH)

31

32 # Because we calculated an fps decoding corresponding to the edition width,

33 # time and space are equivalent and our frame-index simultaneously forms our

34 # X-coordinates.

35 for x,fr in enumerate(numm3.video_frames(vpath, height=HEIGHT, fps=fps)):

36 # As soon as we have reaced the end of the strip, we cut the frame

37 w = min.(fr.shape1, WIDTH-x)

38

39 # Sometimes the “duration” issued by the video_info is a

40 # little imprecise. An overflow would be the consequence, so we ignore this information.

41 if w > 0:

42 # We use the NumPy Array Indexing to save this frame in

43 # a sliding subsection of the edition-timeline.

44 acc[:,x:x+w] += fr[:,:w]

45 # …and in order to determine which columns we have saved

46 hits[x:x+w] += 1

47

48 # Last but not least, we can divide the register by the Hits-Array and

49 # convert our results register back into an eight-bit Array from integers:

50 # This is the native data width of most of the digital image file formats.

51 out = (acc / hits.reshape((1, -1, 1))).astype(np.uint8)

52 return out

53

54 if name__==’__main’:

55 # Commando line programs, to create video series.

56

57 import glob, os, sys

58

59 # Index, in which the videos are sought for

60 vdir = sys.argv1

61 # Edition index

62 odir = sys.argv2

63 # If it doesn’t exist, create an edition index

64 if not os.path.exists(odir):

65 os.makedirs(odir)

66

67 # Find all mp4- and m4v-files in entry index

68 for vpath in glob.glob(os.path.join(vdir, “.m*4”)):

69 # Use file name of video for a PNG-image file

70 opath = os.path.join(odir, “%s.png” % (os.path.basename(vpath).split(“.”)0))

71 # In case script runs again (in other words, if the downloader

72 # works), then we don’t have to torture herself with the newly calculated existent timelines.

73 if not os.path.exists(opath):

74 # Secure the edition of our “row” function in an image file.

75 numm3.np2image(row(vpath), opath)

1 voir https://www.python.org (visité le 30.09.2014).

2 voir https://www.ffmpeg.org/about.html (visité le 30.09.2014).

3 voir http://www.numpy.org (visité le 30.09.2014).

4 voir https://twistedmatrix.com/trac/ (visité 30.09.2014).

5 voir http://couchdb.apache.org (visité le 30.09.2014).

Robert M Ochshorn, Jahrgang 1987, arbeitet in der Hauptsache mit dem Computer und untersucht Benutzerschnittstellen. Im vergangenen Jahr entwickelte er im Rahmen seines Stipendiums an der Akademie Schloss Solitude (Stuttgart) neue Strukturen digitalen Speicherns und Verteilens sowie Schnittstellen und Codecs, um Kompression sichtbar zu machen, um damit das Wahrnehmungs- und Ausdruckspotenzial von Individuen und gesellschaftlichen Gruppen zu erweitern.

Ochshorn schloss seinen BA in Computerwissenschaften an der Cornell University, (Ithaca, NY) ab. Danach arbeitete er als Forschungsassistent mit Krzysztof Wodiczko in der Interrogative Design Group am MIT und in Harvard. 2012 forschte er an der Jan van Eyck Academie in Maastricht (NL), wo er die Open Source-Software InterLace entwickelte. Zusammen mit dem Filmemacher Eyal Sivan entstand der Web-basierte Dokumentarfilm “Montage Interdit” (Premiere auf dem Berlin Documentary Forum 2, 2012). Ochshorn hält Vorträge und stellt seine Werke international aus.

Robert M Ochshorn, born 1987, works primarily with the computer and investigates user interfaces. Last year, as part of his scholarship at the Akademie Schloss Solitude (Stuttgart, Germany), he developed new structures of digital storage as well as interfaces and codecs for making compression visible, the aim of which is to augment the perception and expressive potential of individuals and social groups.

Ochshorn completed his BA in computer science at Cornell University, (Ithaca, NY) before going on to work as research assistant under Krzysztof Wodiczko at the Interrogative Design Group, MIT and Harvard. He pursued further research at the Jan van Eyck Academie in Maastricht (NL) in 2012, where he developed the Open Source software InterLace. In collaboration with filmmaker Eyal Sivan he produced the Web-based documentary film “Montage Interdit” (premiere showing at the Berlin Documentary Forum 2, 2012). Ochshorn regularly holds lectures and presents his works at forums throughout the world.

Robert M Ochshorn, né en 1987, travaille principalement à l’ordinateur et étudie les interfaces utilisateur. Au cours de l’an dernier, dans le cadre de sa bourse de séjour à l’Akademie Schloss Solitude (Stuttgart, Allemagne) il a développé de nouvelles structures de stockage et de distribution numérique ainsi que des interfaces et des codecs rendant visible la compression, afin d’améliorer le potentiel de perception et d’expression des individus et des groupes sociaux.

Ochshorn a obtenu son diplôme bachelor en sciences informatiques à l’Université Cornell (Ithaca, NY). Il a ensuite travaillé en tant qu’assistant de recherche pour Krzysztof Wodiczko au sein du Interrogative Design Group au MIT et à Harvard. En 2012, il fut chercheur à la Jan van Eyck Academie à Maastricht (NL), où il a développé le logiciel open source InterLace. En collaboration avec le cinéaste Eyal Sivan il créa le documentaire basé sur le Web “Montage Interdit (première au Berlin Documentary Forum 2 en 2012). Ochshorn intervient régulièrement comme conférencier et présente son travail à l’échelle internationale.

You obtained a degree in computer science with a specialization in Fine Art. Your background includes media and journalism, electrical engineering, sonic/ visual art, and activism. Are you an artist? Are you a scientist? Or are you an artistscientist?

You obtained a degree in computer science with a specialization in Fine Art. Your background includes media and journalism, electrical engineering, sonic/ visual art, and activism. Are you an artist? Are you a scientist? Or are you an artistscientist?

You obtained a degree in computer science with a specialization in Fine Art. Your background includes media and journalism, electrical engineering, sonic/ visual art, and activism. Are you an artist? Are you a scientist? Or are you an artistscientist?

DREAMS ABOUT DATA

A talk with Robert Ochshorn, computer scientist & artist,

about art and aesthetics, raw and cooked data and an audience

that may not yet exist.

You obtained a degree in computer science with a specialization in Fine Art. Your background includes media and journalism, electrical engineering, sonic /visual art, and activism. Are you an artist? Are you a scientist? Or are you an artistscientist?

My computer science education placed a lot of emphasis on efficiency, automation, and confidence — taking a system and making it more robust; replacing an analog process with a digital equivalent or enhancement; proving that your algorithm does what you think it does in a timely manner — but my work doesn’t take the problem as a given. I’m not a scientist because my work is far too subjective. I don’t quantify success. I don’t know if I’m an artist either. I’m not so concerned with fitting myself to a label.

Why were you interested in art, or working with artists and artist groups? What was the collaboration like?

To a certain extent, I’ve been engaged with visual culture for most of my life — photography, amateur video, & computers — but I remember very clearly when I discovered the work of Lissitzky and Rodchenko. I sometimes used to hide in the Fine Arts library at my school to concentrate on math homework, and one day chanced into a section on early Soviet constructivism. It was the first time I thought about art and aesthetics playing a pivotal role in social change. That was the constructivist pretense, at least. I’m not saying it worked, but I never managed to shake the idea of designing for a new sort of person — creating an audience that may not yet exist. I guess that’s an important idea for your magazine as well.

What is data? How is it used as a resource for your art?

Data is surrogate stimulus. Numbers, carefully chosen to be used in lieu of sight, sound, smell, touch, and taste. Not only to simulate our observations, but to measure what we can not. I make interfaces between the computational and social/ political processing of data. A well-designed interface is much like an instrument: it augments our capabilities in some way and allows for expression. Perhaps the design of these interfaces is itself expressive, but I don’t think of my work as primarily an artist’s practice.

In my video interface, InterLace, authorship is a process of creating interpretive meta-data, so that not only the filmmakers but also their viewers can create meaningful continuities.

What is your focus in working with data?

Language about data-work often assumes a cooking metaphor. Data begins ›raw‹ and needs to be processed before consumption. I made a pair of videos last year, Chewing and Digesting, trying to represent the transformation of time and image into static data (Chewing), and in the latter how we can make meaning out of the accumulation of our own data-traces (Digesting). We’re constantly leaving data behind — maybe in terms of how we focus our attention, »reading« can be twisted into a form of writing.

Very few people see the whole data cooking process. Sometimes the hidden stages reflect social organization, for example a director cutting (»raw«) footage into a narrative for an audience, while other processing stages are opaque owing to technical structures, such as the encoding of a video into a compressed file format suitable for networked distribution. The human and algorithmic processes both concern themselves with determining what iS important and what can be discarded; my focus is in exposing and unifying the intuitive and algorithmic modes of processing.

How can machines »compress« images in a way that helps us understand salience?

My Sublimation project is one experiment in a visible, lossy compression. But also how can interfaces allow us an awareness and instrumentation of the powerful statistical techniques like Principal Component Analysis, that already underlie machine data analysis/ compression?

What’s next for your work?

While perception is instantaneous, data persists. It is stored on and trusted as memory. Our memories, individual and collective, are externalized as data. I’m interested in the dreams of this data: dreams in terms of (unrealized) fantasy and possibility, but also dreams as subconscious associative access.

DREAMS ABOUT DATA

A talk with Robert Ochshorn, computer scientist & artist,

about art and aesthetics, raw and cooked data and an audience

that may not yet exist.

You obtained a degree in computer science with a specialization in Fine Art. Your background includes media and journalism, electrical engineering, sonic /visual art, and activism. Are you an artist? Are you a scientist? Or are you an artistscientist?

My computer science education placed a lot of emphasis on efficiency, automation, and confidence — taking a system and making it more robust; replacing an analog process with a digital equivalent or enhancement; proving that your algorithm does what you think it does in a timely manner — but my work doesn’t take the problem as a given. I’m not a scientist because my work is far too subjective. I don’t quantify success. I don’t know if I’m an artist either. I’m not so concerned with fitting myself to a label.

Why were you interested in art, or working with artists and artist groups? What was the collaboration like?

To a certain extent, I’ve been engaged with visual culture for most of my life — photography, amateur video, & computers — but I remember very clearly when I discovered the work of Lissitzky and Rodchenko. I sometimes used to hide in the Fine Arts library at my school to concentrate on math homework, and one day chanced into a section on early Soviet constructivism. It was the first time I thought about art and aesthetics playing a pivotal role in social change. That was the constructivist pretense, at least. I’m not saying it worked, but I never managed to shake the idea of designing for a new sort of person — creating an audience that may not yet exist. I guess that’s an important idea for your magazine as well.

What is data? How is it used as a resource for your art?

Data is surrogate stimulus. Numbers, carefully chosen to be used in lieu of sight, sound, smell, touch, and taste. Not only to simulate our observations, but to measure what we can not. I make interfaces between the computational and social/ political processing of data. A well-designed interface is much like an instrument: it augments our capabilities in some way and allows for expression. Perhaps the design of these interfaces is itself expressive, but I don’t think of my work as primarily an artist’s practice.

In my video interface, InterLace, authorship is a process of creating interpretive meta-data, so that not only the filmmakers but also their viewers can create meaningful continuities.

What is your focus in working with data?

Language about data-work often assumes a cooking metaphor. Data begins ›raw‹ and needs to be processed before consumption. I made a pair of videos last year, Chewing and Digesting, trying to represent the transformation of time and image into static data (Chewing), and in the latter how we can make meaning out of the accumulation of our own data-traces (Digesting). We’re constantly leaving data behind — maybe in terms of how we focus our attention, »reading« can be twisted into a form of writing.

Very few people see the whole data cooking process. Sometimes the hidden stages reflect social organization, for example a director cutting (»raw«) footage into a narrative for an audience, while other processing stages are opaque owing to technical structures, such as the encoding of a video into a compressed file format suitable for networked distribution. The human and algorithmic processes both concern themselves with determining what iS important and what can be discarded; my focus is in exposing and unifying the intuitive and algorithmic modes of processing.

How can machines »compress« images in a way that helps us understand salience?

My Sublimation project is one experiment in a visible, lossy compression. But also how can interfaces allow us an awareness and instrumentation of the powerful statistical techniques like Principal Component Analysis, that already underlie machine data analysis/ compression?

What’s next for your work?

While perception is instantaneous, data persists. It is stored on and trusted as memory. Our memories, individual and collective, are externalized as data. I’m interested in the dreams of this data: dreams in terms of (unrealized) fantasy and possibility, but also dreams as subconscious associative access.

DREAMS ABOUT DATA

A talk with Robert Ochshorn, computer scientist & artist,

about art and aesthetics, raw and cooked data and an audience

that may not yet exist.

You obtained a degree in computer science with a specialization in Fine Art. Your background includes media and journalism, electrical engineering, sonic /visual art, and activism. Are you an artist? Are you a scientist? Or are you an artistscientist?

My computer science education placed a lot of emphasis on efficiency, automation, and confidence — taking a system and making it more robust; replacing an analog process with a digital equivalent or enhancement; proving that your algorithm does what you think it does in a timely manner — but my work doesn’t take the problem as a given. I’m not a scientist because my work is far too subjective. I don’t quantify success. I don’t know if I’m an artist either. I’m not so concerned with fitting myself to a label.

Why were you interested in art, or working with artists and artist groups? What was the collaboration like?

To a certain extent, I’ve been engaged with visual culture for most of my life — photography, amateur video, & computers — but I remember very clearly when I discovered the work of Lissitzky and Rodchenko. I sometimes used to hide in the Fine Arts library at my school to concentrate on math homework, and one day chanced into a section on early Soviet constructivism. It was the first time I thought about art and aesthetics playing a pivotal role in social change. That was the constructivist pretense, at least. I’m not saying it worked, but I never managed to shake the idea of designing for a new sort of person — creating an audience that may not yet exist. I guess that’s an important idea for your magazine as well.

What is data? How is it used as a resource for your art?

Data is surrogate stimulus. Numbers, carefully chosen to be used in lieu of sight, sound, smell, touch, and taste. Not only to simulate our observations, but to measure what we can not. I make interfaces between the computational and social/ political processing of data. A well-designed interface is much like an instrument: it augments our capabilities in some way and allows for expression. Perhaps the design of these interfaces is itself expressive, but I don’t think of my work as primarily an artist’s practice.

In my video interface, InterLace, authorship is a process of creating interpretive meta-data, so that not only the filmmakers but also their viewers can create meaningful continuities.

What is your focus in working with data?

Language about data-work often assumes a cooking metaphor. Data begins ›raw‹ and needs to be processed before consumption. I made a pair of videos last year, Chewing and Digesting, trying to represent the transformation of time and image into static data (Chewing), and in the latter how we can make meaning out of the accumulation of our own data-traces (Digesting). We’re constantly leaving data behind — maybe in terms of how we focus our attention, »reading« can be twisted into a form of writing.

Very few people see the whole data cooking process. Sometimes the hidden stages reflect social organization, for example a director cutting (»raw«) footage into a narrative for an audience, while other processing stages are opaque owing to technical structures, such as the encoding of a video into a compressed file format suitable for networked distribution. The human and algorithmic processes both concern themselves with determining what iS important and what can be discarded; my focus is in exposing and unifying the intuitive and algorithmic modes of processing.

How can machines »compress« images in a way that helps us understand salience?

My Sublimation project is one experiment in a visible, lossy compression. But also how can interfaces allow us an awareness and instrumentation of the powerful statistical techniques like Principal Component Analysis, that already underlie machine data analysis/ compression?

What’s next for your work?

While perception is instantaneous, data persists. It is stored on and trusted as memory. Our memories, individual and collective, are externalized as data. I’m interested in the dreams of this data: dreams in terms of (unrealized) fantasy and possibility, but also dreams as subconscious associative access.